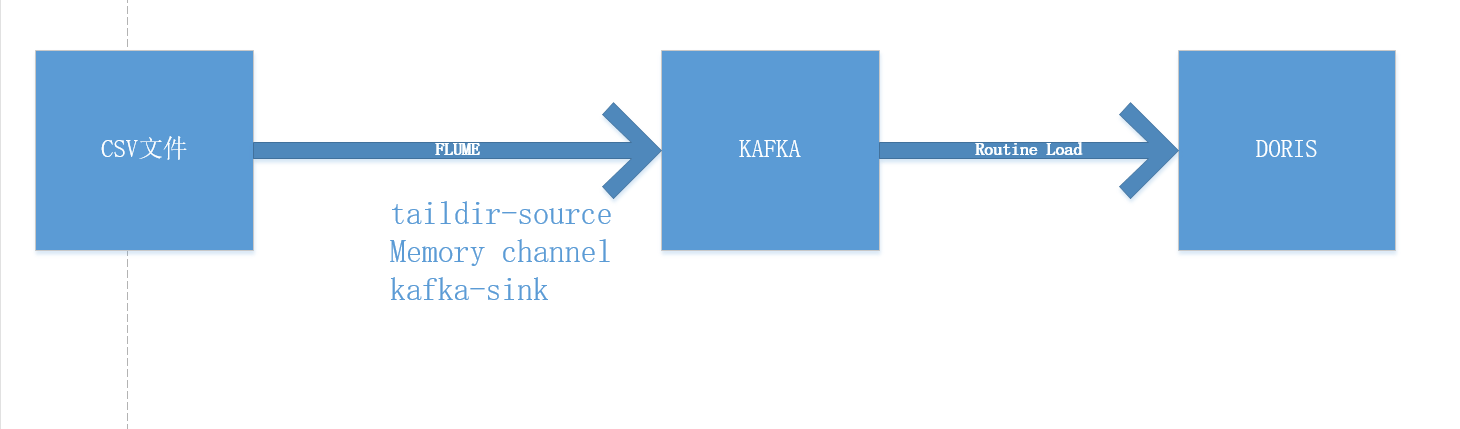

以上是过程

原始csv文件中的字符串带双引号,数字不带,如"abc",123,"def"

通过routine load写库到Doris中,表中的数据也是带双引号的

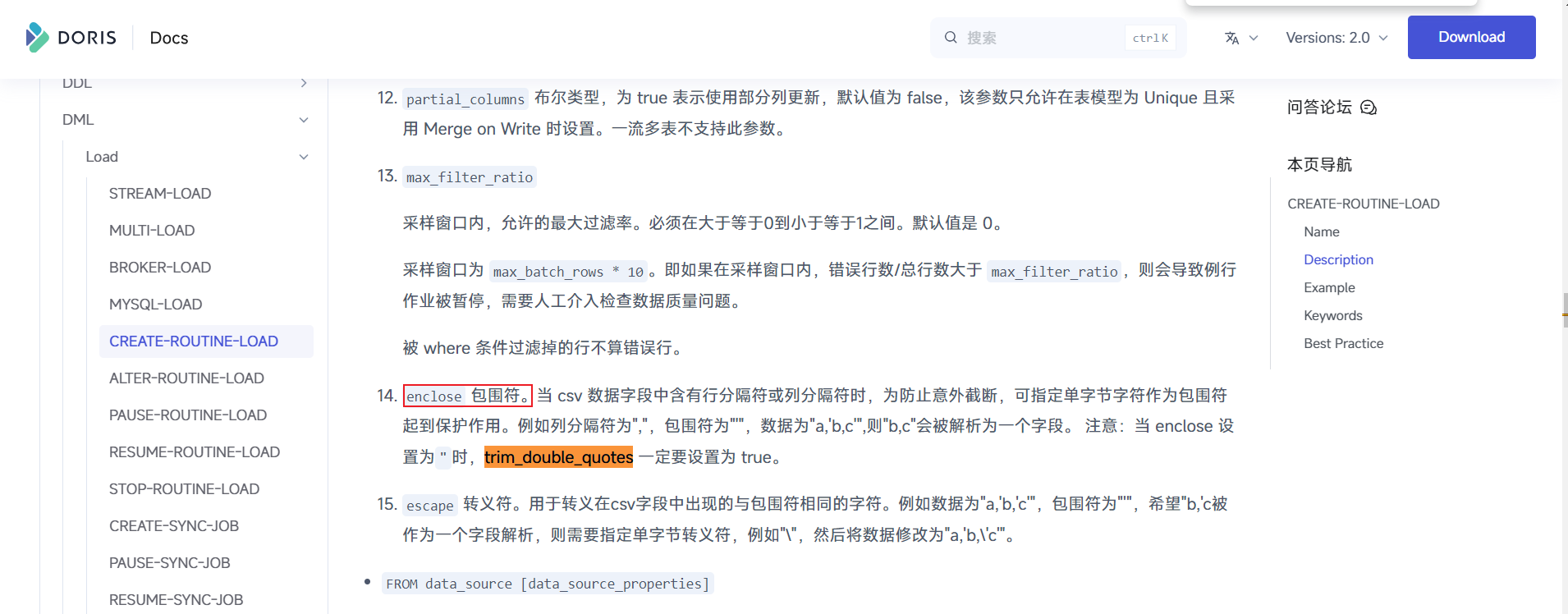

这个双引号如何去掉

trim_double_quotes报错

PROPERTIES

(

"desired_concurrent_number"="3",

"strict_mode"="false",

"trim_double_quotes"="TRUE"

)

报错

1105 - errCode = 2, detailMessage = trim_double_quotes is invalid property

enclose报错

PROPERTIES

(

"desired_concurrent_number"="3",

"strict_mode" = "false",

"enclose" = """

)

包围符也报错,这个具体如何使用

1105 - errCode = 2, detailMessage = enclose is invalid property

Version : doris-2.0.10